2月22日讯 今天凌晨,谷歌宣布推出全球性能最强大、轻量级的可商用开源模型系列Gemma。

该模型共分为分为2B(20亿参数)和7B(70亿)两种尺寸版本,2B版本甚至可直接在笔记本电脑上运行。

Gemma 官方页面:https://ai.google.dev/gemma/

技术报告链接:https://storage.googleapis.com/deepmind-media/gemma/gemma-report.pdf

谷歌表示,Gemma采用与Gemini模型相同的研究和技术,由Google DeepMind和谷歌其他团队开发,专为负责任的AI开发而打造。

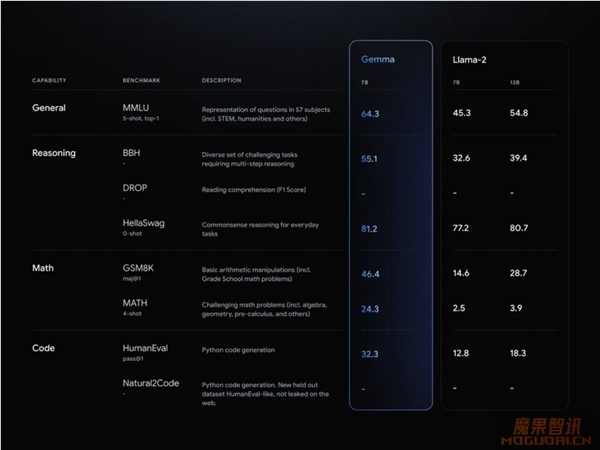

谷歌声称,Gemma模型18个语言理解、推理、数学等关键基准测试中,有11个测试分数超越了Meta Llama-2等更大参数的开源模型。

平均分数方面,Gemma-7B的基准测试平均分高达56.4,远超过Llama-13B(52.2)、Mistral-7B(54.0),成为目前全球最强大的开源模型。

新的 Responsible Generative AI Toolkit 为使用 Gemma 创建更安全的 AI 应用程序提供指导和必备工具。谷歌还通过原生 Keras3.0兼容所有主流框架(JAX、PyTorch 和 TensorFlow),为 Gemma 提供推理和监督微调(SFT)的工具链。

在各家大厂和人工智能研究机构探索千亿级多模态大模型的同时,很多创业公司也正在致力于构建体量在数十亿级别的语言模型。而 Meta 去年推出的 Llama 系列震动了行业,并引发了人们对于生成式 AI 开源和闭源路线的讨论。

谷歌表示,Gemma 采用了与构建 Gemini 模型相同的研究和技术。不过,Gemma 直接打入开源生态系统的出场方式,与 Gemini 截然不同。谷歌也并未遵守在去年定下的「不再开放核心技术」的策略。

虽然开发者可以在 Gemini 的基础上进行开发,但要么通过 API,要么在谷歌的 Vertex AI 平台上进行开发,被认为是一种封闭的模式。与同为闭源路线的 OpenAI 相比,未见优势。

但借助此次 Gemma 的开源,谷歌或许能够吸引更多的人使用自己的 AI 模型,而不是直接投奔 Meta、Mistral 这样的竞争对手。

谷歌这次没有预告的开源,或许是想抢在 Meta 的 Llama3之前一天,毕竟此前有消息称 Llama 系列本周就要上新(让我们期待第一时间的评测对比)。

在开源模型的同时,谷歌还公布了有关 Gemma 的性能、数据集组成和建模方法的详细信息的技术报告。在技术报告中,其他研究者发现了一些亮点,比如 Gemma 支持的词汇表大小达到了256K,这意味着它对英语之外的其他语言能够更好、更快地提供支持。

谷歌和Alphabet公司CEO桑达尔皮查伊(Sundar Pichai)表示,Gemma展示了强大的性能,从今天开始,该模型将在全球范围内提供服务。

并且还实现了跨设备兼容,可以在笔记本电脑、台式机、物联网、移动设备和云端等多个主流设备类型上运行,支持广泛的AI功能。