2月3日讯 智谱今日宣布正式发布并开源 GLM-OCR。据介绍,该模型仅 0.9B 参数规模,支持 vLLM、SGLang 和 Ollama 部署,在公式识别、表格识别、信息抽取的多项主流基准中均取得 SOTA 表现。

官方详细介绍如下:

今天,我们正式发布并开源 GLM-OCR,以“小尺寸、高精度”实现文档解析能力新标杆。作为一款轻量的专业级 OCR 模型,其核心亮点如下:

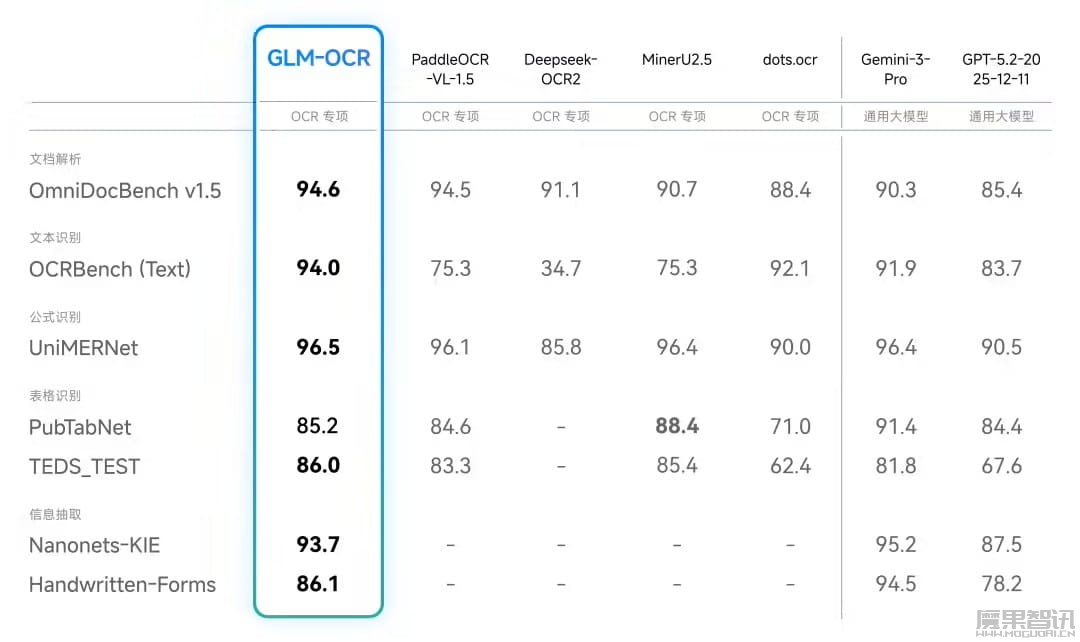

- 性能 SOTA:以 94.6 分登顶 OmniDocBench V1.5,并在公式识别、表格识别、信息抽取的多项主流基准中均取得 SOTA 表现;

- 场景优化:专攻真实业务痛点,在手写体、复杂表格、代码文档及印章等高难场景中表现稳健;

- 推理高效:仅 0.9B 参数规模,支持 vLLM、SGLang 和 Ollama 部署,显著降低推理延迟与算力开销,适合高并发与边缘部署;

- 开源易用:同步开源完整 SDK 与推理工具链,环境依赖简单,支持一行命令快速调用,轻松接入现有业务系统。

性能 SOTA、精准干活儿

得益于自研 CogViT 视觉编码器与深度场景优化,GLM-OCR 实现了“小尺寸,高精度”。

GLM-OCR 参数量仅 0.9B,但在权威文档解析榜单 OmniDocBench V1.5 中以 94.6 分取得 SOTA 性能。在文本、公式、表格识别及信息抽取四大细分领域的表现优于多款 OCR 专项模型,性能接近 Gemini-3-Pro。

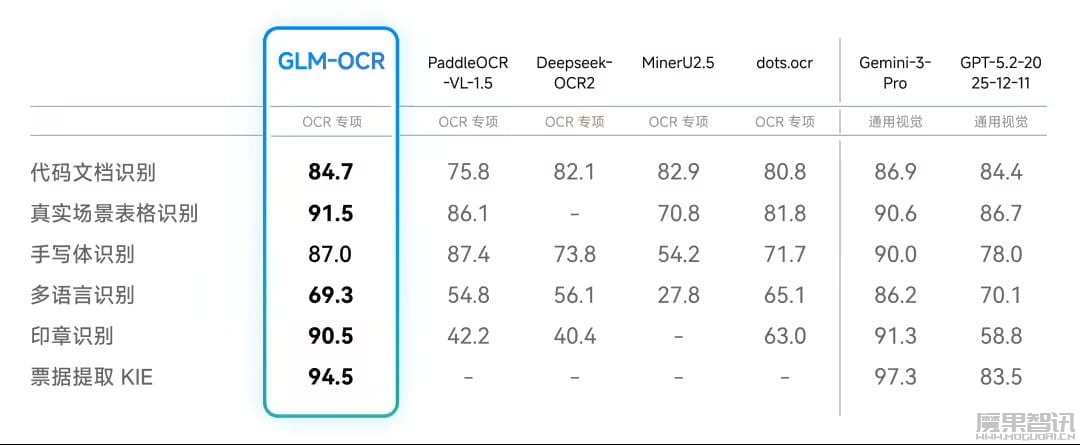

除了公开榜单,我们还针对真实业务中的六大核心场景进行了内部测评。结果显示,GLM-OCR 在代码文档、真实场景表格、手写体、多语言、印章识别、票据提取等维度均取得显著优势。