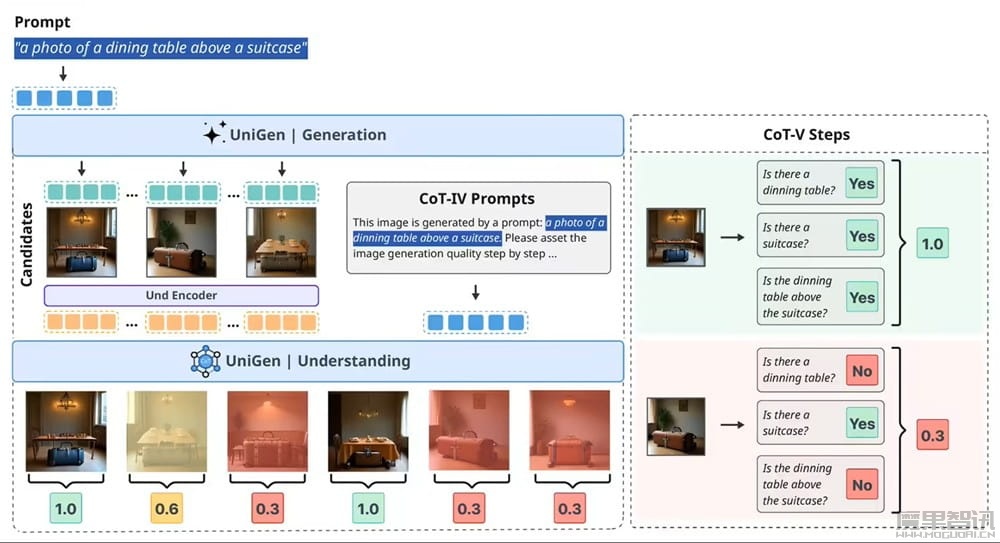

12月19日讯 科技媒体 9to5Mac 昨日(12 月 18 日)发布博文,报道称苹果研究团队近日发布多模态 AI 模型 UniGen 1.5,成功在单一系统中集成了图像理解、生成与编辑三大核心功能。

与主要依赖不同模型分别处理任务的传统方案不同,UniGen 1.5 最大的突破在于构建了一个统一的框架,仅凭一个模型即可同时完成图像理解、图像生成以及图像编辑任务。研究人员认为,这种统一架构能让模型利用强大的图像理解能力反哺生成效果,从而实现更精准的视觉输出。

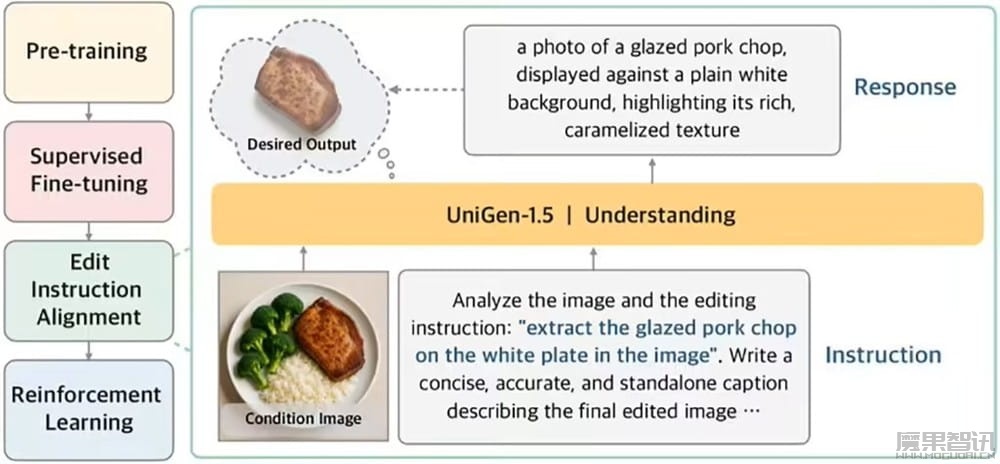

在图像编辑领域,模型往往难以精准捕捉用户微妙或复杂的修改指令。苹果团队为解决这一难题,首创引入了名为“编辑指令对齐”的后训练阶段。

该技术并不直接让模型修改图片,而是要求模型先根据原图和指令,预测出目标图像的详细文本描述。这种“先想后画”的中间步骤,迫使模型在生成最终图像前,必须深度内化用户的编辑意图,从而大幅提升了修改的准确度。

这一中间步骤有助于模型在生成最终图像之前更好地理解预期的编辑内容。

除了指令对齐,UniGen 1.5 的另一大贡献在于强化学习层面的创新。研究团队成功设计了一套统一的奖励系统,能够同时应用于图像生成和图像编辑的训练过程。