3月4日讯 微软今日宣布,通过 Azure AI Foundry 接入 DeepSeek-R1 7B 和 14B 蒸馏模型,为 Copilot+ PC 提供本地运行 7B 和 14B 模型的能力。

早在今年 1 月,微软就宣布计划将 DeepSeek-R1 模型的 NPU 优化版本直接带到搭载高通骁龙 X 处理器的 Copilot+ PC 上。如今,这个承诺终于兑现。

从微软官方博客获悉,模型将从搭载高通骁龙 X 处理器的 Copilot+ PC 开始上线,随后是英特尔酷睿 Ultra 200V 和 AMD 锐龙的设备。

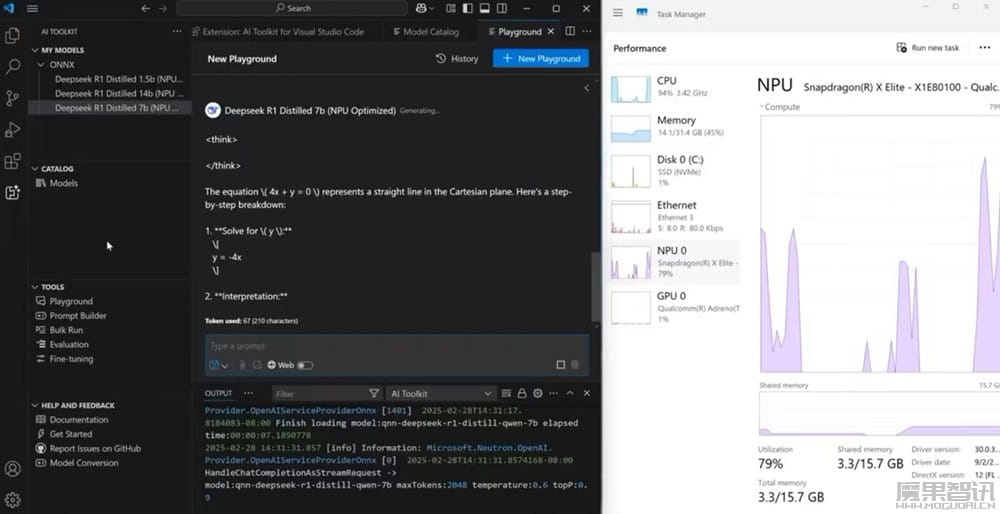

由于模型运行在 NPU 上,因此可以减少对 PC 电池续航和散热性能影响的同时,持续获得 AI 计算能力,CPU 和 GPU 将可用于执行其他任务。

微软强调,它使用了 Aqua 内部自动量化工具,将所有 DeepSeek 模型变体量化为 int4 权重。不幸的是,模型标记速度相当低。微软报告称,14B 模型的标记速度仅为 8 tok / 秒,而 1.5B 模型的标记速度接近 40 tok / 秒。微软提到,该公司正在进一步优化提高速度。

开发者可以通过 AI Toolkit VS Code 扩展在 Copilot+ PC 上下载和运行 DeepSeek 模型的 1.5B、7B 和 14B 版本。