4月29日讯 在人工智能领域,人大系初创公司智子引擎近日发布了一款名为Awaker1.0的全新多模态大模型,标志着向通用人工智能(AGI)迈出了重要一步。该模型在写真视频效果上超越了Sora,展现了其在视觉生成方面的卓越能力。

4月27日,在中关村论坛的通用人工智能平行论坛上,智子引擎展示了这款业界首个真正实现自主更新的多模态大模型。Awaker1.0采用了创新的MOE架构,具备自主更新能力,能够生成高质量的多模态内容,模拟现实世界,同时在执行任务中将场景行为数据反哺给模型,实现持续更新与训练。

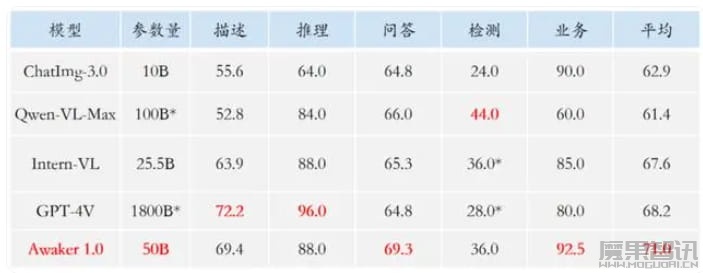

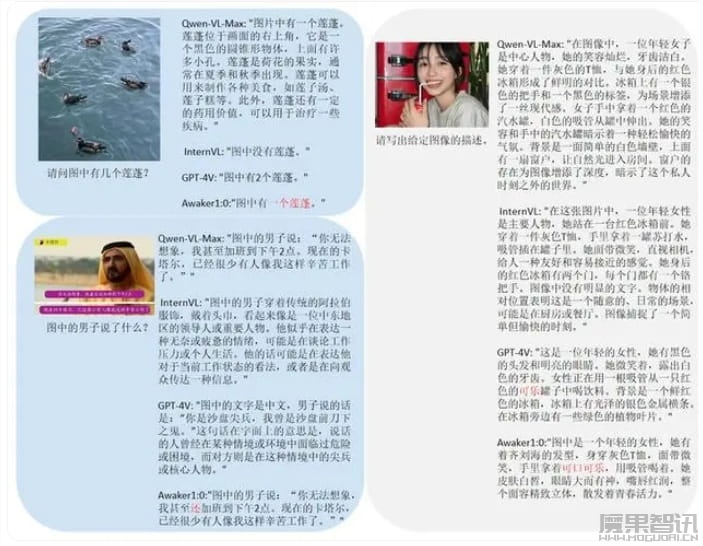

在视觉问答和业务应用任务上,Awaker1.0的基座模型超越了GPT-4V、Qwen-VL-Max和Intern-VL等国内外先进模型。此外,它还在描述、推理和检测任务上达到了次好的效果,证明了多任务MOE架构的有效性。

结合具身智能,Awaker1.0被认为可能成为实现AGI的可行路径。它通过自主探索环境,发现新策略和解决方案,提升具身智能的适应性和创造性。Awaker1.0的自主更新机制包含数据主动生成、模型反思评估和模型连续更新三大关键技术,使其能够实时持续地更新参数。

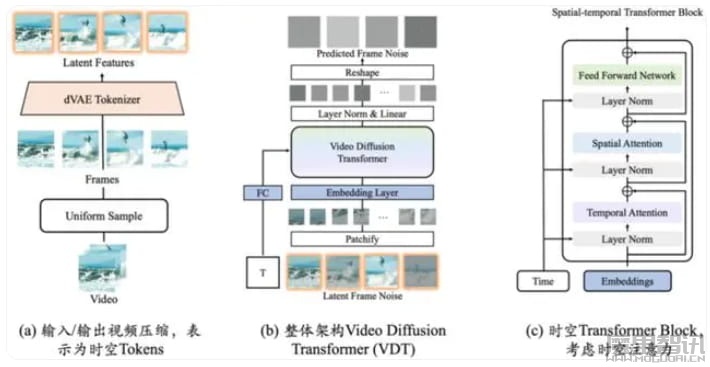

智子引擎自主研发的类Sora视频生成底座VDT,作为现实世界的模拟器,展现了Transformer技术在视频生成领域的潜力。VDT能够处理多种视频生成任务,如无条件生成、视频后续帧预测等,并在写真视频生成任务上取得了比Sora更好的质量。

Awaker1.0的发布是智子引擎团队向实现AGI目标迈进的关键一步。团队认为,AI的自我探索、自我反思等自主学习能力是智能水平的重要评估标准。Awaker1.0在理解侧和生成侧都实现了效果突破,有望加速多模态大模型行业的发展,最终让人类实现AGI。